Muzyka elektroniczna -Electronic music

| Muzyka elektroniczna | |

|---|---|

| Inne nazwy | Elektroniczna |

| Początki stylistyczne | |

| Początki kulturowe | Początek XX wieku , Francja , Stany Zjednoczone , Niemcy |

| Formy pochodne | |

| Inne tematy | |

| Muzyka elektroniczna |

|---|

| Formy eksperymentalne |

| Popularne style |

| Inne tematy |

Muzyka elektroniczna to gatunek muzyki , który wykorzystuje elektroniczne instrumenty muzyczne , instrumenty cyfrowe lub technologię muzyczną opartą na obwodach . Obejmuje zarówno muzykę wykonaną za pomocą środków elektronicznych, jak i elektromechanicznych ( muzyka elektroakustyczna ). Czysto elektroniczne instrumenty polegały całkowicie na generowaniu dźwięku w oparciu o obwody, na przykład przy użyciu urządzeń takich jak oscylator elektroniczny , theremin lub syntezator . Instrumenty elektromechaniczne mogą mieć części mechaniczne, takie jak struny, młotki i elementy elektryczne, w tym przetworniki magnetyczne , wzmacniacze mocy i głośniki . Do takich urządzeń elektromechanicznych należą telharmonium , organy Hammonda , pianino elektryczne i gitara elektryczna .

Pierwsze elektroniczne urządzenia muzyczne powstały pod koniec XIX wieku. W latach 20. i 30. wprowadzono instrumenty elektroniczne i powstały pierwsze kompozycje z nimi związane. W latach czterdziestych magnetyczna taśma audio pozwalała muzykom nagrywać dźwięki, a następnie modyfikować je poprzez zmianę prędkości lub kierunku taśmy, co doprowadziło do rozwoju muzyki na taśmie elektroakustycznej w latach czterdziestych w Egipcie i Francji. Musique concrète , stworzona w Paryżu w 1948 roku, polegała na zmontowaniu razem nagranych fragmentów dźwięków naturalnych i industrialnych. Muzyka produkowana wyłącznie z generatorów elektronicznych została po raz pierwszy wyprodukowana w Niemczech w 1953 roku. Muzyka elektroniczna powstała również w Japonii i Stanach Zjednoczonych od lat 50. XX wieku , aw tej samej dekadzie po raz pierwszy zademonstrowano kompozycję algorytmiczną za pomocą komputerów.

W latach 60. pojawiła się cyfrowa muzyka komputerowa , pojawiły się innowacje w elektronice na żywo , a japońskie elektroniczne instrumenty muzyczne zaczęły wpływać na przemysł muzyczny . We wczesnych latach 70. syntezatory Moog i japońskie automaty perkusyjne pomogły spopularyzować zsyntetyzowaną muzykę elektroniczną. Lata 70. to także okres, w którym muzyka elektroniczna zaczęła wywierać znaczący wpływ na muzykę popularną , wraz z przyjęciem syntezatorów polifonicznych , bębnów elektronicznych , automatów perkusyjnych i gramofonów , poprzez pojawienie się takich gatunków jak disco , krautrock , nowa fala , synth-pop , hip chmiel i EDM . Na początku lat 80. popularne stały się masowo produkowane cyfrowe syntezatory , takie jak Yamaha DX7 , i opracowano MIDI (Musical Instrument Digital Interface). W tej samej dekadzie, z większym uzależnieniem od syntezatorów i przyjęciem programowalnych automatów perkusyjnych, elektroniczna muzyka popularna wyszła na pierwszy plan. W latach 90., wraz z upowszechnieniem się coraz bardziej przystępnej technologii muzycznej, produkcja muzyki elektronicznej stała się ugruntowaną częścią kultury popularnej . Współczesna muzyka elektroniczna obejmuje wiele odmian i zakresów, od eksperymentalnej muzyki artystycznej po popularne formy, takie jak elektroniczna muzyka taneczna . Popowa muzyka elektroniczna jest najbardziej rozpoznawalna w formie 4/4 i bardziej związana z głównym nurtem niż poprzednie formy, które były popularne na niszowych rynkach.

Pochodzenie: koniec XIX wieku do początku XX wieku

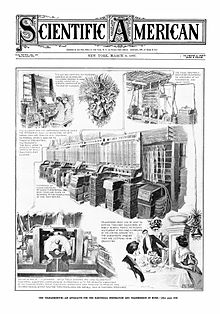

Na przełomie XIX i XX wieku eksperymenty z wschodzącą elektroniką doprowadziły do powstania pierwszych elektronicznych instrumentów muzycznych . Te początkowe wynalazki nie zostały sprzedane, ale zostały wykorzystane w demonstracjach i publicznych występach. Publiczności zostały zaprezentowane reprodukcje istniejącej muzyki zamiast nowych kompozycji na instrumenty. Podczas gdy niektóre były uważane za nowości i produkowały proste dźwięki, Telharmonium zsyntetyzowało brzmienie kilku instrumentów orkiestrowych z rozsądną precyzją. Osiągnął realne zainteresowanie opinii publicznej i poczynił komercyjny postęp w strumieniowym przesyłaniu muzyki przez sieci telefoniczne .

Krytycy konwencji muzycznych w tamtym czasie dopatrywali się w tych zmianach obiecujących. Ferruccio Busoni zachęcał do komponowania muzyki mikrotonowej, na którą pozwalają instrumenty elektroniczne. Przewidział użycie maszyn w muzyce przyszłości, pisząc wpływowy Szkic nowej estetyki muzyki (1907). Futuryści , tacy jak Francesco Balilla Pratella i Luigi Russolo , zaczęli komponować muzykę z akustycznym hałasem , aby przywoływać dźwięk maszyn . We wpływowym manifeście The Art of Noises (1913) przewidzieli ekspansję barwy , na którą pozwala elektronika .

Wczesne kompozycje

Rozwój lampy próżniowej doprowadził do powstania instrumentów elektronicznych, które były mniejsze, wzmocnione i bardziej praktyczne pod względem wydajności. W szczególności theremin , ondes Martenot i trautonium były produkowane na skalę przemysłową na początku lat 30. XX wieku.

Od końca lat 20. XX wieku zwiększona praktyczność instrumentów elektronicznych skłoniła kompozytorów, takich jak Joseph Schillinger , do ich przyjęcia. Były one zazwyczaj używane w orkiestrach , a większość kompozytorów napisała partie do theremina, które w innym przypadku można by wykonać na instrumentach smyczkowych .

Kompozytorzy awangardowi skrytykowali dominujące wykorzystywanie instrumentów elektronicznych do konwencjonalnych celów. Instrumenty oferowały rozszerzenia zasobów dźwiękowych, które były wykorzystywane przez zwolenników muzyki mikrotonowej, takich jak Charles Ives , Dimitrios Levidis , Olivier Messiaen i Edgard Varèse . Co więcej, Percy Grainger użył theremina, aby całkowicie porzucić ustaloną tonację, podczas gdy rosyjscy kompozytorzy, tacy jak Gavriil Popov , traktowali go jako źródło hałasu w muzyce noise .

Nagrywanie eksperymentów

Rozwój wczesnej technologii nagrywania był podobny do rozwoju instrumentów elektronicznych. Pierwszy sposób nagrywania i odtwarzania dźwięku został wynaleziony pod koniec XIX wieku wraz z fonografem mechanicznym . Gramofony stały się powszechnym przedmiotem gospodarstwa domowego, a do lat dwudziestych kompozytorzy używali ich do odtwarzania krótkich nagrań podczas występów.

Po wprowadzeniu nagrań elektrycznych w 1925 r. nastąpiły wzmożone eksperymenty z gramofonami. Paul Hindemith i Ernst Toch skomponowali kilka utworów w 1930 roku, nakładając na siebie nagrania instrumentów i wokali z dostosowanymi prędkościami. Pod wpływem tych technik John Cage skomponował Imaginary Landscape nr 1 w 1939 roku, dostosowując prędkość rejestrowanych tonów.

Jednocześnie kompozytorzy zaczęli eksperymentować z nowo opracowaną technologią dźwięku na filmie . Nagrania można było łączyć w kolaże dźwiękowe , takie jak Tristan Tzara , Kurt Schwitters , Filippo Tommaso Marinetti , Walter Ruttmann i Dziga Vertov . Co więcej, technologia umożliwiła tworzenie i modyfikację dźwięku w formie graficznej . Techniki te zostały wykorzystane do skomponowania ścieżek dźwiękowych do kilku filmów w Niemczech i Rosji, oprócz popularnego Dr. Jekylla i Mr. Hyde'a w Stanach Zjednoczonych. Eksperymenty z dźwiękiem graficznym kontynuował Norman McLaren z końca lat 30. XX wieku.

Rozwój: lata 40. do 50. XX wieku

Muzyka z taśmy elektroakustycznej

Pierwszy praktyczny magnetofon został zaprezentowany w 1935 roku. Udoskonalenia technologii wprowadzono przy użyciu techniki AC biasing , co znacznie poprawiło wierność nagrywania. Już w 1942 roku dokonywano próbnych nagrań w stereo . Chociaż rozwój ten ograniczał się początkowo do Niemiec, magnetofony i taśmy zostały sprowadzone do Stanów Zjednoczonych po zakończeniu II wojny światowej. Były one podstawą pierwszego produkowanego komercyjnie magnetofonu w 1948 roku.

W 1944 roku, przed użyciem taśmy magnetycznej do celów kompozytorskich, egipski kompozytor Halim El-Dabh , będąc jeszcze studentem w Kairze , użył nieporęcznego magnetofonu do nagrywania dźwięków starożytnej ceremonii zaaru . Korzystając z urządzeń w studiach Middle East Radio El-Dabh przetwarzał nagrany materiał za pomocą pogłosu, echa, kontroli napięcia i ponownego nagrywania. Uważa się, że rezultatem jest najwcześniejsza kompozycja muzyki na taśmę. Powstała praca została zatytułowana The Expression of Zaar i została zaprezentowana w 1944 roku na wystawie w galerii sztuki w Kairze. Podczas gdy jego początkowe eksperymenty z kompozycją na taśmie nie były wówczas szeroko znane poza Egiptem, El-Dabh jest również znany ze swojej późniejszej pracy w muzyce elektronicznej w Columbia-Princeton Electronic Music Center pod koniec lat pięćdziesiątych.

Muzyka konkretna

Po pracy w Studio d'Essai w Radiodiffusion Française (RDF) na początku lat 40. przypisuje się Pierre'owi Schaefferowi zapoczątkowanie teorii i praktyki muzyki konkretnej. Pod koniec lat 40. eksperymenty z kompozycją dźwiękową przy użyciu gramofonów szelakowych po raz pierwszy przeprowadził Schaeffer. W 1950 roku rozszerzono techniki muzyki konkretnej, kiedy do zbadania praktyk manipulacji dźwiękiem, takich jak zmiana prędkości ( przesunięcie wysokości tonu ) i łączenie taśm, wykorzystano maszyny z taśmą magnetyczną .

5 października 1948 r. RDF nadało Etude aux chemins de fer Schaeffera . Był to pierwszy „ ruch ” Cinq études de bruits i zapoczątkował realizacje studyjne i muzykę konkretną (czyli sztukę akusmatyczną). Schaeffer zastosował tokarkę do cięcia płyt , cztery gramofony, czterokanałowy mikser, filtry, komorę echa i mobilną jednostkę nagrywającą. Niedługo po tym Pierre Henry rozpoczął współpracę z Schaeffer, partnerstwem, które miałoby głęboki i trwały wpływ na kierunek muzyki elektronicznej. Inny współpracownik Schaeffera, Edgard Varèse , rozpoczął pracę nad Déserts , utworem na orkiestrę kameralną i taśmę. Części taśmy powstały w pracowni Pierre'a Schaeffera, a później zostały zrewidowane na Uniwersytecie Columbia.

W 1950 roku Schaeffer dał pierwszy publiczny (nie emitowany) koncert muzyki konkretnej w École Normale de Musique de Paris . „Schaeffer użył systemu PA , kilku gramofonów i mikserów. Występ nie poszło dobrze, ponieważ nigdy wcześniej nie robiono montaży na żywo z gramofonami”. Jeszcze w tym samym roku Pierre Henry współpracował z Schaefferem nad Symfonią pour un homme seul (1950), pierwszym wielkim dziełem muzyki konkretnej. W Paryżu w 1951 roku, zgodnie z trendem, który miał stać się ważnym światowym trendem, RTF założyło pierwsze studio do produkcji muzyki elektronicznej. Również w 1951 Schaeffer i Henry wyprodukowali operę Orfeusz na konkretne dźwięki i głosy.

W 1951 roku twórczość Schaeffera, kompozytora- perkusisty Pierre'a Henry'ego i inżyniera dźwięku Jacquesa Poullina została oficjalnie uznana, a The Groupe de Recherches de Musique Concrète , Club d'Essai de la Radiodiffusion-Télévision Française została założona w RTF w Paryżu, przodek ORTF . _

Muzyka elektroniczna

Karlheinz Stockhausen pracował krótko w studiu Schaeffera w 1952 roku, a następnie przez wiele lat w Studiu Muzyki Elektronicznej WDR w Kolonii .

W 1954 r. pojawiły się to, co byłoby teraz uważane za autentyczne kompozycje elektryczne i akustyczne – instrumentacja akustyczna wzbogacona/akompaniowana przez nagrania zmanipulowanego lub generowanego elektronicznie dźwięku. W tym roku miały swoją premierę trzy główne utwory: Desery Varèse'a na zespół kameralny i dźwięki taśmowe oraz dwa utwory Otto Lueninga i Vladimira Ussachevsky'ego : Wariacje rapsodyczne na orkiestrę symfoniczną z Louisville i Poemat w cyklach i dzwonach , zarówno na orkiestrę, jak i taśmę. Ponieważ pracował w studiu Schaeffera, taśma w utworze Varèse zawiera znacznie więcej konkretnych dźwięków niż elektroniczne. „Grupa składająca się z instrumentów dętych, perkusji i pianina przeplata się ze zmutowanymi dźwiękami fabrycznych dźwięków oraz syren i silników okrętowych dochodzących z dwóch głośników”.

Podczas niemieckiej premiery Deserts w Hamburgu, którą dyrygował Bruno Maderna , sterowaniem taśmy sterował Karlheinz Stockhausen. Tytułowe pustynie sugerowały Varèse nie tylko „wszystkie fizyczne pustynie (piasku, morza, śniegu, kosmosu, pustych ulic), ale także pustynie w umyśle człowieka; nie tylko te obnażone aspekty natury, które sugerują nagość, dystansu, ponadczasowości, ale także tej odległej przestrzeni wewnętrznej, do której żaden teleskop nie może dotrzeć, gdzie człowiek jest sam, świata tajemnicy i zasadniczej samotności.

W Kolonii, w 1953 roku, w studiach radiowych NWDR , oficjalnie otwarto w Kolonii to, co stało się najsłynniejszym studiem muzyki elektronicznej na świecie, choć było ono w fazie planowania już w 1950 roku, a wczesne kompozycje powstały i wyemitowano w 1951 roku. Do studia dołączyli wkrótce Karlheinz Stockhausen i Gottfried Michael Koenig . W swojej pracy magisterskiej Elektronische Klangerzeugung z 1949 roku: Elektronische Musik und Synthetische Sprache , Meyer-Eppler wpadł na pomysł, aby zsyntetyzować muzykę całkowicie z sygnałów wyprodukowanych elektronicznie; W ten sposób elektronische Musik została ostro odróżniona od francuskiej muzyki konkretnej , która wykorzystywała dźwięki rejestrowane ze źródeł akustycznych.

W 1953 Stockhausen skomponował Studie I , a w 1954 Elektronische Studie II — pierwszy utwór elektroniczny wydany w formie partytury. W 1955 roku zaczęły powstawać kolejne studia eksperymentalne i elektroniczne. Godne uwagi było utworzenie Studio di fonologia musicale di Radio Milano , studia w NHK w Tokio założonego przez Toshiro Mayuzumi , oraz studia Philipsa w Eindhoven , Holandia , które w 1960 roku przeniosło się na Uniwersytet w Utrechcie jako Instytut Sonologii .

„Z rezydencją Stockhausena i Mauricio Kagela stał się całorocznym ulem charyzmatycznej awangardy [ sic ]” dwukrotnie łącząc elektronicznie generowane dźwięki ze stosunkowo konwencjonalnymi orkiestrami — w Mixtur ( 1964) i Hymnen, dritte Region mit Orchester ( 1967). Stockhausen stwierdził, że jego słuchacze powiedzieli mu, że jego muzyka elektroniczna dała im doświadczenie „kosmicznej przestrzeni”, wrażenia latania lub przebywania w „fantastycznym świecie marzeń”. Niedawno Stockhausen zajął się produkcją muzyki elektronicznej we własnym studiu w Kürten , jego ostatnim dziełem w tym medium był Cosmic Pulses (2007).

Japońska muzyka elektroniczna

Najwcześniejsza grupa elektronicznych instrumentów muzycznych w Japonii, Yamaha Magna Organ , została zbudowana w 1935 roku. Jednak po II wojnie światowej japońscy kompozytorzy, tacy jak Minao Shibata , wiedzieli o rozwoju elektronicznych instrumentów muzycznych. Pod koniec lat 40. japońscy kompozytorzy zaczęli eksperymentować z muzyką elektroniczną, a sponsoring instytucjonalny umożliwił im eksperymentowanie z zaawansowanym sprzętem. Ich włączenie muzyki azjatyckiej do wyłaniającego się gatunku w końcu wesprze popularność Japonii w rozwoju technologii muzycznej kilkadziesiąt lat później.

Po założeniu firmy elektronicznej Sony w 1946 roku, kompozytorzy Toru Takemitsu i Minao Shibata niezależnie badali możliwe zastosowania technologii elektronicznej do produkcji muzyki. Takemitsu miał idee podobne do muzyki konkretnej , o której nie wiedział, podczas gdy Shibata przewidział rozwój syntezatorów i przewidział drastyczną zmianę w muzyce. Sony rozpoczęło produkcję popularnych magnetofonów do użytku rządowego i publicznego.

Awangardowy kolektyw Jikken Kōbō (Warsztat Eksperymentalny), założony w 1950 roku, otrzymał od Sony dostęp do nowych technologii audio. Firma zatrudniła Toru Takemitsu, aby zademonstrował swoje magnetofony z kompozycjami i wykonaniami muzyki elektronicznej. Pierwszymi utworami na taśmie elektronicznej grupy były „Toraware no Onna” („Uwięziona kobieta”) i „Piece B”, skomponowane w 1951 roku przez Kuniharu Akiyamę. Wiele wyprodukowanych przez nich taśm elektroakustycznych zostało wykorzystanych jako muzyka okazjonalna dla radia , filmu i teatru . Zorganizowali także koncerty z pokazem slajdów zsynchronizowanym z nagraną ścieżką dźwiękową. Kompozytorzy spoza Jikken Kōbō, tacy jak Yasushi Akutagawa , Saburo Tominaga i Shirō Fukai , również eksperymentowali z muzyką na taśmie radiofonicznej w latach 1952-1953.

Muzykę konkretną wprowadził do Japonii Toshiro Mayuzumi , który był pod wpływem koncertu Pierre'a Schaeffera. Od 1952 komponował utwory na taśmę do filmu komediowego, audycji radiowej i słuchowiska radiowego. Jednak koncepcja obiektu dźwiękowego Schaeffera nie miała wpływu na kompozytorów japońskich, których interesowało głównie przezwyciężanie ograniczeń ludzkiej wydajności. Doprowadziło to do tego, że kilku japońskich muzyków elektroakustycznych wykorzystało serializm i techniki dwunastotonowe , widoczne w dodekafonicznym utworze Yoshirō Irino „Concerto da Camera” z 1951 roku, w organizacji dźwięków elektronicznych w „X, Y, Z for Musique Concrète” Mayuzumiego. , a później w muzyce elektronicznej Shibaty do 1956 roku.

Wzorując się na studiu NWDR w Kolonii, NHK założył w 1955 roku w Tokio studio muzyki elektronicznej, które stało się jednym z wiodących światowych obiektów muzyki elektronicznej. Studio NHK zostało wyposażone w takie technologie jak sprzęt do generowania tonu i przetwarzania dźwięku, sprzęt rejestrujący i radiofoniczny, ondes Martenot, Monochord i Melochord , oscylatory sinusoidalne , magnetofony, modulatory pierścieniowe , filtry pasmowe oraz cztero- i ośmioprzepustowe . miksery kanałowe . Muzycy związani ze studiem to Toshiro Mayuzumi, Minao Shibata, Joji Yuasa, Toshi Ichiyanagi i Toru Takemitsu. Pierwsze elektroniczne kompozycje studia zostały ukończone w 1955 roku, w tym pięciominutowe utwory Mayuzumiego „Studium I: Muzyka dla fali sinusoidalnej według proporcji liczby pierwszej”, „Muzyka dla fali modulowanej według proporcji liczby pierwszej” i „Invention for Square Wave i Sawtooth”. Wave” wyprodukowany z wykorzystaniem różnych możliwości studia w zakresie generowania tonów oraz 20-minutowy utwór stereo Shibaty „Musique Concrète for Stereophonic Broadcast”.

Amerykańska muzyka elektroniczna

W Stanach Zjednoczonych muzyka elektroniczna powstawała już w 1939 roku, kiedy John Cage wydał Imaginary Landscape, No. 1 , wykorzystując dwa gramofony o zmiennej prędkości, nagrania częstotliwości, wyciszony fortepian i talerze, ale bez elektronicznych środków produkcji. Cage skomponował pięć kolejnych „Pejzaży urojonych” w latach 1942-1952 (jeden wycofany), głównie na zespół perkusyjny, chociaż nr 4 dotyczy dwunastu radiostacji, a nr 5, napisany w 1952 roku, wykorzystuje 42 nagrania i ma być zrealizowany jako magnetofon taśma. Według Otto Lueninga, Cage wykonał również William [ sic ] Mix w Donaueschingen w 1954 roku, używając ośmiu głośników, trzy lata po jego rzekomej współpracy. Williams Mix odniósł sukces na festiwalu w Donaueschingen , gdzie zrobił „mocne wrażenie”.

Projekt Music for Magnetic Tape Project został utworzony przez członków szkoły nowojorskiej ( John Cage , Earle Brown , Christian Wolff , David Tudor i Morton Feldman ) i trwał trzy lata, aż do 1954 roku. Cage napisał o tej współpracy: „W tym społecznym ciemność, zatem praca Earle'a Browna, Mortona Feldmana i Christiana Wolffa nadal przedstawia wspaniałe światło, ponieważ w kilku punktach zapisu, wykonania i przesłuchania akcja jest prowokacyjna”.

Cage ukończył Williams Mix w 1953 roku, pracując z Music for Magnetic Tape Project. Grupa nie miała stałej siedziby i musiała polegać na pożyczonym czasie w komercyjnych studiach dźwiękowych, w tym w studiu Louisa i Bebe Barronów .

Centrum Columbia-Princeton

W tym samym roku Columbia University zakupiła swój pierwszy magnetofon – profesjonalną maszynę Ampex – do nagrywania koncertów. Vladimir Ussachevsky, który pracował na wydziale muzycznym Uniwersytetu Columbia, został odpowiedzialny za urządzenie i niemal natychmiast zaczął z nim eksperymentować.

Herbert Russcol pisze: „Wkrótce zaintrygowały go nowe brzmienia, które mógł osiągnąć, nagrywając instrumenty muzyczne, a następnie nakładając je na siebie”. Ussachevsky powiedział później: „Nagle zdałem sobie sprawę, że magnetofon można traktować jako instrument transformacji dźwięku”. W czwartek, 8 maja 1952, Ussachevsky zaprezentował kilka pokazów muzyki na taśmie/efektów, które stworzył na swoim Composers Forum, w McMillin Theatre na Uniwersytecie Columbia. Należą do nich Transpozycja, Pogłos, Eksperyment, Kompozycja i Walec Podwodny . W jednym z wywiadów stwierdził: „Podałem kilka przykładów mojego odkrycia na publicznym koncercie w Nowym Jorku wraz z innymi kompozycjami, które napisałem na instrumenty konwencjonalne”. Otto Luening, który uczestniczył w tym koncercie, zauważył: „Sprzęt, jakim dysponował, składał się z magnetofonu Ampex... i prostego, przypominającego pudełko urządzenia zaprojektowanego przez genialnego młodego inżyniera, Petera Mauzeya, do tworzenia sprzężenia zwrotnego, pewnego rodzaju mechanicznego pogłosu. Inny sprzęt został pożyczony lub zakupiony za środki osobiste.”

Zaledwie trzy miesiące później, w sierpniu 1952, Ussachevsky udał się do Bennington w stanie Vermont, na zaproszenie Lueninga, aby zaprezentować swoje eksperymenty. Tam obaj współpracowali przy różnych utworach. Luening tak opisał to wydarzenie: „Wyposażony w słuchawki i flet zacząłem tworzyć swoją pierwszą kompozycję na magnetofon. Oboje byliśmy płynnymi improwizatorami, a medium pobudzało naszą wyobraźnię”. Nieformalnie zagrali kilka wczesnych utworów na imprezie, na której „liczni kompozytorzy niemal uroczyście gratulowali nam, mówiąc: 'To jest to' ('to' oznacza muzykę przyszłości).'

Wieść szybko dotarła do Nowego Jorku. Oliver Daniel zadzwonił i zaprosił parę do „wyprodukowania grupy krótkich kompozycji na październikowy koncert sponsorowany przez American Composers Alliance i Broadcast Music, Inc. pod kierownictwem Leopolda Stokowskiego w Museum of Modern Art w Nowym Jorku. wahanie, zgodziliśmy się… Henry Cowell oddał do naszej dyspozycji swój dom i pracownię w Woodstock w stanie Nowy Jork. Z pożyczonym sprzętem z tyłu samochodu Ussachevsky'ego wyjechaliśmy z Bennington do Woodstock i zatrzymaliśmy się na dwa tygodnie… W pod koniec września 1952 wędrowne laboratorium dotarło do salonu Ussachevsky'ego w Nowym Jorku, gdzie ostatecznie ukończyliśmy kompozycje”.

Dwa miesiące później, 28 października, Vladimir Ussachevsky i Otto Luening zaprezentowali pierwszy w Stanach Zjednoczonych koncert Tape Music. Koncert obejmował Fantazję w kosmosie Lueninga (1952) – „impresjonistyczny utwór wirtuozowski ” wykorzystujący zmanipulowane nagrania fletu – oraz Low Speed (1952), „egzotyczną kompozycję, która sprowadziła flet znacznie poniżej jego naturalnego zakresu”. Oba utwory powstały w domu Henry'ego Cowella w Woodstock w stanie Nowy Jork. Po tym, jak kilka koncertów wywołało sensację w Nowym Jorku, Ussachevsky i Luening zostali zaproszeni na transmisję na żywo programu NBC Today Show, aby przeprowadzić pokaz wywiadu — pierwszy telewizyjny występ elektroakustyczny. Luening opisał to wydarzenie: „Zaimprowizowałem kilka sekwencji [flet] na magnetofon. Ussachevsky wtedy i tam poddał je elektronicznym przekształceniom”.

Muzyka do Forbidden Planet , autorstwa Louisa i Bebe Barronów , została w całości skomponowana przy użyciu wykonanych na zamówienie obwodów elektronicznych i magnetofonów taśmowych w 1956 roku (ale bez syntezatorów we współczesnym znaczeniu tego słowa).

Australia

Pierwszym na świecie komputerem do odtwarzania muzyki był CSIRAC , zaprojektowany i zbudowany przez Trevora Pearceya i Mastona Bearda. Matematyk Geoff Hill zaprogramował CSIRAC do odtwarzania popularnych melodii muzycznych z wczesnych lat pięćdziesiątych. W 1951 r. zagrał publicznie Marsz pułkownika Bogey , z którego nie ma żadnych znanych nagrań, a jedynie dokładną rekonstrukcję. Jednak CSIRAC grał standardowy repertuar i nie był używany do rozwijania muzycznego myślenia czy praktyki kompozytorskiej. CSIRAC nigdy nie został nagrany, ale odtwarzana muzyka została dokładnie zrekonstruowana. Najstarsze znane nagrania muzyki generowanej komputerowo zostały odtworzone przez komputer Ferranti Mark 1 , komercyjną wersję Baby Machine z Uniwersytetu w Manchesterze jesienią 1951 roku. Program muzyczny napisał Christopher Strachey .

Od połowy do końca lat 50.

Wpływ komputerów był kontynuowany w 1956 roku. Lejaren Hiller i Leonard Isaacson skomponowali Iliac Suite na kwartet smyczkowy , pierwsze kompletne dzieło kompozycji wspomaganej komputerowo przy użyciu kompozycji algorytmicznej . „… Hiller postulował, że komputera można nauczyć zasad określonego stylu, a następnie wezwać do odpowiedniego komponowania”. Późniejsze osiągnięcia obejmowały pracę Maxa Mathewsa z Bell Laboratories , który opracował wpływowy program MUSIC I w 1957 roku, jeden z pierwszych programów komputerowych do odtwarzania muzyki elektronicznej. Technologia Vocoder była również ważnym osiągnięciem w tej wczesnej erze. W 1956 Stockhausen skomponował Gesang der Jünglinge , pierwsze większe dzieło kolońskiego studia, oparte na tekście z Księgi Daniela . Ważnym osiągnięciem technologicznym tamtego roku było wynalezienie przez Raymonda Scotta syntezatora Clavivox z podzespołem Roberta Mooga .

W 1957 Kid Baltan ( Dick Raaymakers ) i Tom Dissevelt wydali swój debiutancki album Song Of The Second Moon , nagrany w studiu Philipsa w Holandii. Publiczność pozostała zainteresowana nowymi dźwiękami powstającymi na całym świecie, co można wywnioskować z włączenia Poème électronique Varèse'a , który był odtwarzany na ponad czterystu głośnikach w Pawilonie Philipsa na Światowych Targach w Brukseli w 1958 roku . W tym samym roku skomponował Transición II argentyński kompozytor Mauricio Kagel . Praca została zrealizowana w studiu WDR w Kolonii. Dwóch muzyków grało na fortepianie, jeden w tradycyjny sposób, drugi na strunach, ramie i futerale. Dwóch innych wykonawców wykorzystało taśmę, aby powiązać prezentację dźwięków na żywo z przyszłością wcześniej nagranych materiałów i przeszłością nagrań dokonanych wcześniej w spektaklu.

W 1958 roku Columbia-Princeton opracowała syntezator dźwięku RCA Mark II , pierwszy programowalny syntezator . Wybitni kompozytorzy, tacy jak Vladimir Ussachevsky, Otto Luening, Milton Babbitt , Charles Wuorinen , Halim El-Dabh, Bülent Arel i Mario Davidovsky intensywnie wykorzystywali syntezator RCA w różnych kompozycjach. Jednym z najbardziej wpływowych kompozytorów związanych z wczesnymi latami studia był Halim El-Dabh z Egiptu , który po opracowaniu najwcześniejszej znanej muzyki elektronicznej na taśmie w 1944 roku, stał się bardziej znany dzięki Leiyla and the Poet , serii elektronicznych kompozycji z 1959 roku, które wyróżniał się zanurzeniem i płynnym połączeniem muzyki elektronicznej i folkowej , w przeciwieństwie do bardziej matematycznego podejścia stosowanego przez kompozytorów serialowych tamtych czasów, takich jak Babbitt. Leiyla and the Poet El-Dabha , wydana jako część albumu Columbia-Princeton Electronic Music Center w 1961 roku, była wymieniana jako silny wpływ wielu muzyków, od Neila Rolnicka , Charlesa Amirkhaniana i Alice Shieldsa po muzyków rockowych Franka . Zappa i zespół eksperymentalny pop-artu z Zachodniego Wybrzeża .

Po pojawieniu się różnic w obrębie GRMC (Groupe de Recherche de Musique Concrète) Pierre Henry, Philippe Arthuys i kilku ich kolegów zrezygnowało w kwietniu 1958 roku. Schaeffer utworzył nowy kolektyw o nazwie Groupe de Recherches Musicales (GRM) i rozpoczął rekrutacja nowych członków, w tym Luc Ferrari , Beatriz Ferreyra , François-Bernard Mâche , Iannis Xenakis , Bernard Parmegiani i Mireille Chamass-Kyrou. Późniejsi przybyli to Ivo Malec , Philippe Carson, Romuald Vandelle, Edgardo Canton i François Bayle .

Ekspansja: lata 60.

To były płodne lata dla muzyki elektronicznej – nie tylko dla środowiska akademickiego, ale także dla niezależnych artystów, ponieważ technologia syntezatorów stała się bardziej dostępna. W tym czasie powstała i rozwijała się silna społeczność kompozytorów i muzyków pracujących z nowymi dźwiękami i instrumentami. W 1960 roku skomponowano Gargulce Lueninga na skrzypce i taśmę oraz prawykonano Kontakte na dźwięki elektroniczne, fortepian i perkusję Stockhausena. Utwór ten istniał w dwóch wersjach – jedna na taśmę 4-kanałową, a druga na taśmę z wykonawcami. "W Kontakte Stockhausen porzucił tradycyjną formę muzyczną opartą na linearnym rozwoju i dramatycznej kulminacji. To nowe podejście, które nazwał 'formą momentu', przypomina techniki 'splotu filmowego' z filmu z początku XX wieku."

Theremin był używany od lat 20. XX wieku, ale zyskał popularność dzięki zastosowaniu w muzyce soundtrackowej do filmów science-fiction w latach 50. (np. klasyczna ścieżka dźwiękowa Bernarda Herrmanna do „ Dnia, w którym zatrzymała się Ziemia” ).

W Wielkiej Brytanii w tym okresie BBC Radiophonic Workshop (założone w 1958) zyskały na znaczeniu, w dużej mierze dzięki ich pracy nad serialem science-fiction BBC Doctor Who . Jednym z najbardziej wpływowych brytyjskich artystów elektronicznych w tym okresie była pracowniczka Workshop Delia Derbyshire , która jest obecnie znana z elektronicznej realizacji kultowego tematu Doctor Who z 1963 roku , skomponowanego przez Rona Grainera .

W czasie stypendium UNESCO na studia nad muzyką elektroniczną (1958) Josef Tal wyjechał na tournée studyjne do USA i Kanady. Swoje wnioski podsumował w dwóch artykułach, które przedłożył UNESCO. W 1961 założył Centrum Muzyki Elektronicznej w Izraelu na Uniwersytecie Hebrajskim w Jerozolimie. W 1962 roku Hugh Le Caine przybył do Jerozolimy, aby zainstalować w centrum swój kreatywny magnetofon . W latach 90. Tal prowadził, wraz z dr Shlomo Markelem, we współpracy z Technion – Israel Institute of Technology oraz Fundacją Volkswagena, projekt badawczy („Talmark”) mający na celu opracowanie nowatorskiego systemu zapisu nutowego w muzyce elektronicznej.

Milton Babbitt skomponował swoje pierwsze dzieło elektroniczne przy użyciu syntezatora — jego Composition for Synthesizer (1961) — które stworzył przy użyciu syntezatora RCA w Columbia-Princeton Electronic Music Center.

Dla Babbitta syntezator RCA był spełnieniem marzeń z trzech powodów. Po pierwsze, zdolność do precyzyjnego wskazywania i kontrolowania każdego elementu muzycznego. Po drugie, czas potrzebny na realizację jego wymyślnych, seryjnych konstrukcji znalazł się w praktycznym zasięgu. Po trzecie, pytanie nie brzmiało już „Jakie są granice ludzkiego wykonawcy?” ale raczej „Jakie są granice ludzkiego słuchu?”

Współpraca miała również miejsce na oceanach i kontynentach. W 1961 Ussachevsky zaprosił Varèse do studia Columbia-Princeton (CPEMC). Po przybyciu Varese przystąpił do rewizji Desert . Asystowali mu Mario Davidovsky i Bülent Arel .

Intensywna działalność, która miała miejsce w CPEMC i innych miejscach, zainspirowała utworzenie San Francisco Tape Music Center w 1963 roku przez Mortona Subotnicka , z dodatkowymi członkami Pauline Oliveros , Ramon Sender , Anthony Martin i Terry Riley .

Później Centrum przeniosło się do Mills College , kierowanego przez Pauline Oliveros , gdzie dziś znane jest jako Centrum Muzyki Współczesnej.

Równocześnie w San Francisco kompozytor Stan Shaff i projektant sprzętu Doug McEachern zaprezentowali pierwszy koncert „Audium” w San Francisco State College (1962), a następnie pracę w Muzeum Sztuki Nowoczesnej w San Francisco (1963), pomyślanym jak na czasie , kontrolowany ruch dźwięku w przestrzeni. Publiczność otoczyło dwanaście głośników, cztery głośniki zostały zamontowane na obrotowej, przypominającej ruchomość konstrukcji powyżej. W spektaklu SFMOMA w następnym roku (1964) krytyk muzyczny z San Francisco Chronicle Alfred Frankenstein skomentował: „możliwości kontinuum przestrzenno-dźwiękowego rzadko były tak intensywnie badane”. W 1967 r. otwarto pierwsze Audium , „kontinuum dźwiękowo-przestrzenne”, w którym cotygodniowe występy trwają do 1970 r. W 1975 r., dzięki pieniądzom początkowym z National Endowment for the Arts , otwarto nowe Audium, zaprojektowane od podłogi do sufitu w celu przestrzennej kompozycji dźwięku i wydajność. „Z drugiej strony są kompozytorzy, którzy manipulowali przestrzenią dźwiękową, umieszczając wiele głośników w różnych miejscach w przestrzeni występu, a następnie przełączając lub panoramując dźwięk między źródłami. W tym podejściu kompozycja manipulacji przestrzennej zależy od lokalizacji głośników i zwykle wykorzystuje właściwości akustyczne obudowy. Przykłady obejmują Poeme Electronique Varese (muzyka na taśmie grana w Pawilonie Philipsa na Światowych Targach w 1958 w Brukseli) i instalacja Audium Stanleya Schaffa , obecnie działająca w San Francisco. Poprzez cotygodniowe programy (ponad 4500 w ciągu 40 lat) Shaff „rzeźbi” dźwięk, wykonując na żywo zdigitalizowane prace przestrzenne na 176 głośnikach.

Dobrze znanym przykładem zastosowania pełnowymiarowego modularnego syntezatora Moog Moog jest album Wendy Carlos Switched-On Bach z 1968 roku , który wywołał szaleństwo na syntezatorach.

W 1969 roku David Tudor , przy wsparciu rodziny Sarabhai , przyniósł do National Institute of Design w Ahmedabadzie syntezator modularny Moog i magnetofony Ampex , tworząc podwaliny pierwszego w Indiach studia muzyki elektronicznej. Tutaj grupa kompozytorów Jinraj Joshipura, Gita Sarabhai, SC Sharma, IS Mathur i Atul Desai opracowała eksperymentalne kompozycje dźwiękowe w latach 1969-1973

Oprócz syntezatora modularnego Moog, inne marki tego okresu to ARP i Buchla.

Pietro Grossi był włoskim pionierem kompozycji komputerowej i muzyki na taśmie, który jako pierwszy eksperymentował z technikami elektronicznymi na początku lat sześćdziesiątych. Grossi był wiolonczelistą i kompozytorem, urodzonym w Wenecji w 1917 roku. W 1963 założył S 2F M (Studio de Fonologia Musicale di Firenze), aby eksperymentować z dźwiękiem elektronicznym i kompozycją.

Muzyka komputerowa

Melodie muzyczne zostały po raz pierwszy wygenerowane przez komputerowy CSIRAC w Australii w 1950 roku. W Ameryce i Anglii pojawiły się doniesienia (wcześnie i niedawno), że komputery mogły odtwarzać muzykę wcześniej, ale dokładne badania obaliły te historie, ponieważ nie ma dowodów na poparcie doniesienia prasowe (niektóre z nich miały oczywiście charakter spekulacyjny). Badania wykazały, że ludzie spekulowali na temat komputerów odtwarzających muzykę, prawdopodobnie dlatego, że komputery wydawałyby dźwięki, ale nie ma dowodów na to, że faktycznie to robili.

Pierwszym na świecie komputerem do odtwarzania muzyki był CSIRAC , zaprojektowany i zbudowany przez Trevora Pearceya i Mastona Bearda w latach 50. XX wieku. Matematyk Geoff Hill zaprogramował CSIRAC do odtwarzania popularnych melodii muzycznych z wczesnych lat pięćdziesiątych. W 1951 r. zagrał publicznie „ Marsz pułkownika straszydła ”, którego nagranie nie jest znane. Jednak CSIRAC grał standardowy repertuar i nie był używany do rozszerzania myślenia muzycznego lub praktyki komponowania, która jest obecnie praktyką muzyki komputerowej.

Pierwszą muzyką wykonywaną w Anglii było wykonanie brytyjskiego hymnu narodowego , zaprogramowanego przez Christophera Stracheya na Ferranti Mark I, pod koniec 1951 roku. Później w tym samym roku krótkie fragmenty trzech utworów zostały nagrane przez zewnętrzną jednostkę BBC . : hymn narodowy, „ Ba, Ba Black Sheep ” i „ In the Mood ” i jest to uznawane za najwcześniejsze nagranie komputera do odtwarzania muzyki. To nagranie można usłyszeć na stronie Manchester University . Naukowcy z University of Canterbury w Christchurch odklikali i przywrócili to nagranie w 2016 roku, a wyniki można usłyszeć na SoundCloud .

Pod koniec lat pięćdziesiątych, sześćdziesiątych i siedemdziesiątych nastąpił również rozwój syntezy dużych komputerów typu mainframe. Począwszy od 1957, Max Mathews z Bell Labs opracował programy MUSIC, których kulminacją był MUSIC V , język bezpośredniej syntezy cyfrowej.

Laurie Spiegel opracowała algorytmiczne oprogramowanie do komponowania muzyki „ Music Mouse ” (1986) dla komputerów Macintosh , Amiga i Atari .

Muzyka stochastyczna

Ważnym nowym osiągnięciem było pojawienie się komputerów do komponowania muzyki, w przeciwieństwie do manipulowania lub tworzenia dźwięków. Iannis Xenakis zapoczątkował tak zwaną musique stochastique lub muzykę stochastyczną , która jest metodą komponowania wykorzystującą matematyczne systemy prawdopodobieństwa. Różne algorytmy prawdopodobieństwa zostały użyte do stworzenia figury według zestawu parametrów. Xenakis używał komputerów do komponowania utworów takich jak ST/4 na kwartet smyczkowy i ST/48 na orkiestrę (oba 1962), Morsima-Amorsima , ST/10 i Atrées . Opracował komputerowy system UPIC do tłumaczenia obrazów graficznych na wyniki muzyczne i skomponował z nim Mycènes Alpha (1978).

Elektronika na żywo

W Europie w 1964 roku Karlheinz Stockhausen skomponował Mikrofonię I na tam-tam , mikrofony do ręki, filtry i potencjometry oraz Mixtur na orkiestrę, cztery generatory fal sinusoidalnych i cztery modulatory pierścieniowe . W 1965 skomponował Mikrofonię II na chór, organy Hammonda i modulatory pierścieniowe.

W latach 1966-67 Reed Ghazala odkrył i zaczął nauczać „ zginania obwodów ” – zastosowania kreatywnego zwarcia, procesu przypadkowego zwarcia, tworzenia eksperymentalnych instrumentów elektronicznych, eksploracji elementów dźwiękowych głównie barwy i z mniejszym uwzględnieniem wysokości tonu. lub rytmu, pod wpływem aleatorycznej koncepcji muzyki [ sic ] Johna Cage'a .

Sztuka performance i kariera muzyczna Cosey Fanni Tutti badały koncepcję „akceptowalnej” muzyki, a ona dalej badała użycie dźwięku jako środka pożądania lub dyskomfortu.

Wendy Carlos wykonała na scenie utwory z jej albumu Switched-On Bach na syntezatorze z Orkiestrą Symfoniczną St. Louis ; kolejny występ na żywo był z Kurzweil Baroque Ensemble dla „Bach at the Beacon” w 1997 roku.

W czerwcu 2018 roku Suzanne Ciani wydała LIVE Quadraphonic , album koncertowy dokumentujący jej pierwszy solowy występ na syntezatorze Buchla od 40 lat. Był to jeden z pierwszych kwadrofonicznych wydawnictw winylowych od ponad 30 lat.

instrumenty japońskie

W latach pięćdziesiątych japońskie elektroniczne instrumenty muzyczne zaczęły wpływać na międzynarodowy przemysł muzyczny . Ikutaro Kakehashi , który założył Ace Tone w 1960 roku, opracował własną wersję elektronicznej perkusji, która była już popularna na zagranicznych elektronicznych organach. Na NAMM 1964 ujawnił go jako R-1 Rhythm Ace, ręcznie obsługiwane urządzenie perkusyjne, które ręcznie odtwarzało dźwięki perkusji elektronicznej, gdy użytkownik naciskał przyciski, w sposób podobny do nowoczesnych padów perkusji elektronicznej.

W 1963 Korg wypuścił Donca-Matic DA-20 , elektromechaniczną maszynę perkusyjną . W 1965 Nippon Columbia opatentował w pełni elektroniczny automat perkusyjny. Korg wypuścił elektroniczny automat perkusyjny Donca-Matic DC-11 w 1966 roku, po którym pojawił się Korg Mini Pops , który został opracowany jako opcja dla organów elektrycznych Yamaha Electone . Serie Stageman i Mini Pops firmy Korg wyróżniały się „naturalnymi metalicznymi dźwiękami perkusyjnymi” i zawierały elementy sterujące do przerywania i uzupełniania perkusji .

W 1967 r. założyciel Ace Tone Ikutaro Kakehashi opatentował generator zaprogramowanego wzorca rytmu wykorzystujący obwód matrycy diodowej podobny do wcześniejszego patentu Seeburga 3 358 068 zgłoszonego w 1964 r. (Patrz Maszyna perkusyjna # Historia ), który wydał jako FR-1 Rhythm Ace automat perkusyjny z tego samego roku. Oferował 16 gotowych wzorów i cztery przyciski do ręcznego odtwarzania dźwięku każdego instrumentu ( talerze , klawesy , krowi dzwonek i bęben basowy ). Wzorce rytmiczne można było również łączyć kaskadowo, naciskając jednocześnie wiele przycisków rytmicznych, a możliwa kombinacja wzorców rytmicznych wynosiła ponad sto. Automaty perkusyjne Ace Tone Rhythm Ace trafiły do muzyki popularnej w późnych latach 60-tych, a następnie automaty perkusyjne Korg w latach 70-tych. Kakehashi później opuścił Ace Tone i założył Roland Corporation w 1972, a syntezatory i automaty perkusyjne Roland stały się bardzo wpływowe przez następne kilka dekad. Firma będzie miała duży wpływ na muzykę popularną i zrobi więcej dla kształtowania popularnej muzyki elektronicznej niż jakakolwiek inna firma.

Turntablism ma swoje początki w wynalezieniu gramofonów z napędem bezpośrednim . Wczesne gramofony z napędem pasowym nie nadawały się do gramofonu, ponieważ miały powolny czas rozruchu i były podatne na zużycie i pękanie, ponieważ pasek pękał w wyniku odkręcenia wstecznego lub zarysowania. Pierwszy gramofon z napędem bezpośrednim został wynaleziony przez Shuichi Obata, inżyniera w firmie Matsushita (obecnie Panasonic ), z siedzibą w Osace w Japonii . Wyeliminował paski, a zamiast tego zastosował silnik do bezpośredniego napędzania talerza, na którym spoczywa płyta winylowa. W 1969 Matsushita wypuścił go jako SP-10 , pierwszy gramofon z napędem bezpośrednim na rynku i pierwszy z ich wpływowej serii gramofonów Technics . Został on zastąpiony przez Technics SL-1100 i SL-1200 we wczesnych latach 70-tych i zostały one szeroko przyjęte przez muzyków hip-hopowych , przy czym SL-1200 pozostał najczęściej używanym gramofonem w kulturze DJ-ów przez kilka dziesięcioleci.

Jamajska muzyka dub

Na Jamajce w latach 60. pojawiła się popularna forma muzyki elektronicznej, dub music , zakorzeniona w kulturze sound systemowej . Muzykę dubową zapoczątkowali inżynierowie studyjni, tacy jak Sylvan Morris, King Tubby , Errol Thompson , Lee „Scratch” Perry i Scientist , produkujący eksperymentalną muzykę pod wpływem reggae z elektroniczną technologią dźwięku, w studiach nagraniowych i na imprezach nagłośnieniowych. Ich eksperymenty obejmowały formy kompozycji opartej na taśmie porównywalne z aspektami muzyki konkretnej , nacisk na powtarzalne struktury rytmiczne (często pozbawione elementów harmonicznych) porównywalne z minimalizmem , elektroniczną manipulację przestrzennością, dźwiękową elektroniczną manipulację nagranymi wcześniej materiałami muzycznymi. od środków masowego przekazu, didżejów wznoszących toast za wcześniej nagraną muzykę porównywalną z muzyką elektroniczną na żywo , remiksowanie muzyki, turntablism oraz miksowanie i scratchowanie płyt winylowych.

Pomimo ograniczonego sprzętu elektronicznego dostępnego pionierom dubu, takim jak King Tubby i Lee „Scratch” Perry, ich eksperymenty w kulturze remiksów były muzycznie nowatorskie. Na przykład King Tubby był właścicielem nagłośnienia i technikiem elektronicznym, którego małe studio w getcie Waterhouse w zachodnim Kingston było kluczowym miejscem tworzenia muzyki dub.

Późne lata 60-te do początku 80-tych

Powstanie popularnej muzyki elektronicznej

Pod koniec lat 60. muzycy popowi i rockowi , w tym Beach Boys i Beatles , zaczęli używać instrumentów elektronicznych, takich jak theremin i Mellotron , do uzupełniania i definiowania swojego brzmienia. W swojej książce Electronic and Experimental Music , Thom Holmes uznaje nagranie Beatlesów z 1966 roku „ Tomorrow Never Knows ” za piosenkę, która „zapoczątkowała nową erę w wykorzystaniu muzyki elektronicznej w muzyce rockowej i popowej” ze względu na włączenie przez zespół taśmy. pętle oraz odwrócone i manipulowane prędkością dźwięki taśmy.

Również pod koniec lat 60. duet muzyczny Silver Apples i zespoły rocka eksperymentalnego, takie jak White Noise i Stany Zjednoczone Ameryki , uważane są za pionierów gatunku rocka elektronicznego i elektroniki za ich pracę polegającą na łączeniu rocka psychodelicznego z oscylatorami i syntezatorami. Instrumentalny „ Popcorn ” z 1969 roku napisany przez Gershona Kingsleya, niemiecko-amerykańskiego kompozytora, który wydał dwa albumy z francuskim muzykiem elektronicznym Jean-Jacques Perrey , stał się światowym sukcesem dzięki wersji z 1972 wykonanej przez Hot Butter .

Pod koniec lat 60. syntezator Moog zajął czołowe miejsce w brzmieniu rodzącego się progresywnego rocka , a zespoły takie jak Pink Floyd , Yes , Emerson, Lake & Palmer i Genesis uczyniły ich częścią swojego brzmienia. Instrumentalny prog rock był szczególnie ważny w Europie kontynentalnej, pozwalając takim zespołom jak Kraftwerk , Tangerine Dream , Can , Neu! , a Faust do obejścia bariery językowej. Ich ciężki syntezator " krautrock ", wraz z twórczością Briana Eno (czasowego klawiszowca w Roxy Music ), miałby duży wpływ na późniejszy elektroniczny rock .

Ambient dub został zapoczątkowany przez Kinga Tubby'ego i innych jamajskich artystów dźwiękowych , wykorzystujących inspirowaną DJ-ami nastrojową elektronikę, uzupełnioną o drop-outy, echo, wyrównanie i psychodeliczne efekty elektroniczne. Zawierała techniki nakładania warstw i zawierała elementy world music , głębokie linie basowe i dźwięki harmoniczne. Zastosowano również techniki, takie jak długie opóźnienie echa. Inni znani artyści z tego gatunku to Dreadzone , Higher Intelligence Agency , The Orb , Ott , Loop Guru , Woob i Transglobal Underground .

Muzyka dub wpłynęła na elektroniczne techniki muzyczne, które później zostały przyjęte przez muzykę hip-hopową, kiedy jamajski imigrant DJ Kool Herc na początku lat 70. wprowadził do Ameryki kulturę soundsystemową Jamajki i techniki muzyki dubowej. Jedną z takich technik, która stała się popularna w kulturze hip-hopowej , było odtwarzanie naprzemiennie dwóch kopii tej samej płyty na dwóch gramofonach, rozszerzając ulubioną sekcję b-tancerzy . W końcu gramofon stał się najbardziej widocznym elektronicznym instrumentem muzycznym, a czasami najbardziej wirtuozowskim , w latach 80. i 90. XX wieku.

Elektroniczny rock był również produkowany przez kilku japońskich muzyków, w tym Electric Samurai: Switched on Rock Isao Tomity (1972), który zawierał syntezatorowe wersje współczesnych piosenek popowych i rockowych Moog oraz progresywny rockowy album Osamu Kitajima Benzaiten (1974). W połowie lat 70. pojawili się artyści muzyki elektronicznej, tacy jak Jean Michel Jarre , Vangelis , Tomita i Klaus Schulze , którzy mieli znaczący wpływ na rozwój muzyki new-age . Zaawansowany technologicznie urok tych dzieł wytworzył przez kilka lat trend wymieniania elektronicznego sprzętu muzycznego zastosowanego w okładkach albumów, jako cechy wyróżniającej. Muzyka elektroniczna zaczęła regularnie pojawiać się w programach radiowych i na listach bestsellerów, jak francuski zespół Space z ich singlem Magic Fly z 1977 roku .

W tej epoce dźwięk muzyków rockowych, takich jak Mike Oldfield i The Alan Parsons Project (który jest uważany za pierwszą rockową piosenkę z cyfrowym vocoderem w 1975 roku, The Raven ) był kiedyś aranżowany i mieszany z efektami elektronicznymi i/lub muzyką jako dobrze, co stało się znacznie bardziej widoczne w połowie lat osiemdziesiątych. Jeff Wayne odniósł długotrwały sukces dzięki elektronicznej, rockowej wersji musicalu The War of the Worlds z 1978 roku .

Ścieżki dźwiękowe do filmów również korzystają z dźwięku elektronicznego. W 1977 roku Gene Page nagrał dyskotekową wersję przeboju Johna Williamsa z filmu Stevena Spielberga Bliskie spotkania trzeciego stopnia . Wersja Page'a osiągnęła szczyt na liście R&B w 1978 roku. Muzyka do filmu Midnight Express z 1978 roku , skomponowanego przez włoskiego pioniera syntezatorów , Giorgio Morodera , zdobyła Oscara za najlepszą oryginalną muzykę w 1979 roku, podobnie jak w 1981 roku muzyka Vangelisa dla Rydwany ognia .

Po pojawieniu się punk rocka pojawiła się forma podstawowego rocka elektronicznego, coraz częściej wykorzystująca nową technologię cyfrową w celu zastąpienia innych instrumentów. Amerykański duet Suicide , który wyrósł z nowojorskiej sceny punkowej, na swoim albumie z 1977 roku wykorzystał automaty perkusyjne i syntezatory w hybrydzie elektroniki i punka .

Pionierskie zespoły synth-popowe , które przez lata odnosiły sukcesy, to między innymi Ultravox ze swoim utworem „Hiroshima Mon Amour” z 1977 roku w Ha!-Ha!-Ha! , Yellow Magic Orchestra z albumem zatytułowanym (1978), The Buggles z wybitnym debiutanckim singlem z 1979 roku Video Killed the Radio Star , Gary Numan ze swoim solowym debiutanckim albumem The Pleasure Principle oraz singlem Cars z 1979 roku, Orchestral Maneuvers in the Dark z ich singiel Electricity z 1979 roku znalazł się na ich debiutanckim albumie , Depeche Mode z ich pierwszym singlem Dreaming of Me nagranym w 1980 i wydanym w 1981 albumem Speak & Spell , A Flock of Seagulls z ich singlem Talking , New Order with Ceremony z 1981 oraz The Human League z przebojem z 1981 roku Don't You Want Me z trzeciego albumu Dare .

Definicja MIDI i rozwój dźwięku cyfrowego znacznie ułatwiły rozwój czysto elektronicznych dźwięków, a inżynierowie dźwięku , producenci i kompozytorzy często badali możliwości praktycznie każdego nowego modelu elektronicznego sprzętu dźwiękowego wprowadzanego przez producentów. Synth-pop czasami używał syntezatorów w celu zastąpienia wszystkich innych instrumentów, ale częściej zdarzało się, że zespoły miały jednego lub więcej klawiszowców w swoim składzie wraz z gitarzystami, basistami i/lub perkusistami. Te zmiany doprowadziły do rozwoju synth-popu, który po przyjęciu go przez ruch New Romantic pozwolił syntezatorom zdominować muzykę pop i rock początku lat 80., dopóki styl nie zaczął spadać z popularności w połowie do końca. dekady. Oprócz wspomnianych wcześniej odnoszących sukcesy pionierów, do kluczowych wykonawców należą: Yazoo , Duran Duran , Spandau Ballet , Culture Club , Talk Talk , Japan i Eurythmics .

Synth-pop został podjęty na całym świecie, z międzynarodowymi hitami takich zespołów jak Men Without Hats , Trans-X i Lime z Kanady, Telex z Belgii, Peter Schilling , Sandra , Modern Talking , Propaganda i Alphaville z Niemiec, Yello ze Szwajcarii i Azul y Negro z Hiszpanii. Również dźwięk syntezatora jest kluczową cechą Italo-disco .

Niektóre synth-popowe zespoły stworzyły dla siebie futurystyczne style wizualne, aby wzmocnić ideę elektronicznych dźwięków, związanych przede wszystkim z technologią, jak Amerykanie Devo i Hiszpanie Aviador Dro .

Syntezatory klawiszowe stały się tak powszechne, że nawet zespoły heavymetalowo -rockowe, gatunek często uważany za przeciwieństwo pod względem estetyki, brzmienia i stylu życia artystów popu elektronicznego przez fanów obu stron, osiągnęły światowy sukces dzięki tematom w 1983 r. Skok Van Halena i 1986 r . The Final Countdown by Europe , w którym poczesne miejsce zajmują syntezatory.

Rozprzestrzenianie się instytucji badawczych zajmujących się muzyką elektroniczną

Elektronmusikstudion (EMS), wcześniej znany jako Muzyka Elektroakustyczna w Szwecji, to szwedzkie narodowe centrum muzyki elektronicznej i sztuki dźwięku . Organizacja badawcza powstała w 1964 roku i ma siedzibę w Sztokholmie.

STEIM to centrum badań i rozwoju nowych instrumentów muzycznych w elektronicznych sztukach scenicznych z siedzibą w Amsterdamie w Holandii. STEIM istnieje od 1969 roku. Założyli go Misha Mengelberg , Louis Andriessen , Peter Schat , Dick Raaymakers , Jan van Vlijmen , Reinbert de Leeuw i Konrad Boehmer . Ta grupa kompozytorów holenderskich walczyła o reformację feudalnych struktur muzycznych Amsterdamu; nalegali na mianowanie Bruno Maderny na dyrektora muzycznego Concertgebouw Orchestra i wymusiły pierwsze publiczne fundusze na eksperymentalną i improwizowaną muzykę elektroniczną w Holandii.

IRCAM w Paryżu stał się głównym ośrodkiem badań nad muzyką komputerową oraz realizacji i rozwoju systemu komputerowego Sogitec 4X , wyposażonego w rewolucyjne wówczas przetwarzanie sygnału cyfrowego w czasie rzeczywistym. Repons Pierre'a Bouleza ( 1981) na 24 muzyków i 6 solistów wykorzystywał 4X do przekształcania i kierowania solistów do systemu głośnikowego.

Barry Vercoe opisuje jedno ze swoich doświadczeń z wczesnymi dźwiękami komputerowymi:

W IRCAM w Paryżu w 1982 roku flecista Larry Beauregard podłączył swój flet do procesora dźwięku DiGiugno 4X , umożliwiając śledzenie tonu w czasie rzeczywistym. W tym czasie na Guggenheimie rozszerzyłem tę koncepcję na śledzenie partytury w czasie rzeczywistym z automatycznym, zsynchronizowanym akompaniamentem, a przez następne dwa lata Larry i ja daliśmy liczne prezentacje komputera jako kameralista, grając sonaty na flet Haendla , Boulez ”. s Sonatine na flet i fortepian, a do roku 1984 moja własna Synapse II na flet i komputer — pierwszy utwór, jaki kiedykolwiek skomponowano specjalnie dla takiego zestawu. Dużym wyzwaniem było znalezienie odpowiednich konstrukcji oprogramowania do obsługi bardzo czułego i responsywnego akompaniamentu. Wszystko to było przed MIDI, ale wyniki były imponujące, mimo że duże dawki tempa rubato nieustannie zaskakiwały mojego syntetycznego wykonawcę . W 1985 roku rozwiązaliśmy problem rubato tempa, włączając naukę z prób (za każdym razem, gdy grałeś w ten sposób, maszyna stawała się coraz lepsza). Śledziliśmy teraz także skrzypce, ponieważ nasz genialny, młody flecista zachorował na śmiertelnego raka. Co więcej, ta wersja wykorzystywała nowy standard o nazwie MIDI, a tutaj umiejętnie pomagał mi były student Miller Puckette, którego początkowe koncepcje dotyczące tego zadania rozszerzył później do programu o nazwie MAX .

Syntezatory klawiaturowe

Wydany w 1970 roku przez Moog Music , Mini-Moog był jednym z pierwszych szeroko dostępnych, przenośnych i stosunkowo niedrogich syntezatorów. Stał się niegdyś najczęściej używanym syntezatorem w tym czasie zarówno w popularnej, jak i elektronicznej muzyce artystycznej. Patrick Gleeson , grający na żywo z Herbie Hancockiem na początku lat 70., był pionierem w użyciu syntezatorów w kontekście tras koncertowych, gdzie były one poddawane stresom, do których wczesne maszyny nie były przeznaczone.

W 1974 roku studio WDR w Kolonii nabyło syntezator EMS Synthi 100 , którego wielu kompozytorów używało do tworzenia znaczących dzieł elektronicznych – w tym Fünf deutsche Tänze Rolfa Gehlhaara ( 1975), Syriusza Karlheinza Stockhausena (1975–76) i Johna McGuire’a ”. s Pulse Music III (1978).

Dzięki miniaturyzacji elektroniki w latach 70., na początku lat 80. syntezatory klawiszowe stały się lżejsze i niedrogie, integrując w jedną smukłą jednostkę całą niezbędną elektronikę do syntezy dźwięku i samą klawiaturę w stylu fortepianu, w ostrym kontraście z masywną maszynerią oraz „ spaguetty kablowe ” stosowane wraz z latami 60. i 70. XX wieku. Po pierwsze, w przypadku syntezatorów analogowych, trend nastąpił również w przypadku syntezatorów cyfrowych i samplerów (patrz poniżej).

Syntezatory cyfrowe

W 1975 roku japońska firma Yamaha udzieliła licencji na algorytmy syntezy modulacji częstotliwości (synteza FM) od Johna Chowninga , który eksperymentował z nim na Uniwersytecie Stanforda od 1971 roku. Inżynierowie Yamahy zaczęli dostosowywać algorytm Chowninga do wykorzystania w syntezatorze cyfrowym, dodając ulepszenia, takie jak metoda "skalowania klucza", aby uniknąć wprowadzenia zniekształceń, które normalnie występują w układach analogowych podczas modulacji częstotliwości .

W 1980 roku Yamaha ostatecznie wypuściła pierwszy cyfrowy syntezator FM, Yamaha GS-1, ale za wysoką cenę. W 1983 roku Yamaha wprowadziła pierwszy samodzielny syntezator cyfrowy, DX7 , który również wykorzystywał syntezę FM i stał się jednym z najlepiej sprzedających się syntezatorów wszechczasów. DX7 był znany z rozpoznawalnych jasnych tonów, co częściowo wynikało z nadmiernie osiąganej częstotliwości próbkowania 57 kHz.

Korg Poly-800 to syntezator wydany przez Korg w 1983 roku . Jego początkowa cena katalogowa 795 USD uczyniła go pierwszym w pełni programowalnym syntezatorem, który był sprzedawany za mniej niż 1000 USD. Miał 8-głosową polifonię z jednym sterowanym cyfrowo oscylatorem (DCO) na głos.

Casio CZ-101 był pierwszym i najlepiej sprzedającym się syntezatorem zniekształceń fazowych w linii Casio CZ . Wydany w listopadzie 1984 roku był jednym z pierwszych (jeśli nie pierwszym) w pełni programowalnym syntezatorem polifonicznym, który był dostępny za mniej niż 500 USD.

Roland D-50 to cyfrowy syntezator wyprodukowany przez firmę Roland i wydany w kwietniu 1987 roku . Jego funkcje obejmują syntezę subtraktywną , wbudowane efekty, joystick do manipulacji danymi oraz projekt układu w stylu syntezy analogowej. Zewnętrzny programator Roland PG-1000 (1987-1990) można również podłączyć do D-50 w celu bardziej złożonej manipulacji jego dźwiękami.

Próbniki

Sampler to elektroniczny lub cyfrowy instrument muzyczny, który wykorzystuje nagrania dźwiękowe (lub „ próbki ”) dźwięków rzeczywistych instrumentów (np. pianina, skrzypiec lub trąbki), fragmenty nagranych utworów (np. pięciosekundowy riff gitary basowej z funk ) lub znalezione dźwięki (np. syreny i fale oceanu). Próbki są ładowane lub rejestrowane przez użytkownika lub producenta. Dźwięki te są następnie odtwarzane za pomocą samego programu samplera, klawiatury MIDI , sekwencera lub innego urządzenia wyzwalającego (np. perkusji elektronicznej ) w celu wykonywania lub komponowania muzyki. Ponieważ próbki te są zwykle przechowywane w pamięci cyfrowej, informacje można szybko uzyskać. Pojedyncza próbka często może być przesunięta do różnych wysokości, aby wytworzyć skale muzyczne i akordy .

Przed samplerami opartymi na pamięci komputerowej muzycy używali klawiatur magnetofonowych, które przechowują nagrania na taśmie analogowej. Po naciśnięciu klawisza głowica taśmy styka się z poruszającą się taśmą i odtwarza dźwięk. Mellotron był najbardziej godnym uwagi modelem, używanym przez wiele grup w późnych latach 60. i 70., ale takie systemy były drogie i ciężkie ze względu na zastosowanie wielu mechanizmów taśmowych, a zakres instrumentu był ograniczony co najwyżej do trzech oktaw. Aby zmienić dźwięki, w instrumencie trzeba było zainstalować nowy zestaw taśm. Pojawienie się cyfrowego samplera sprawiło, że samplowanie stało się znacznie bardziej praktyczne.

Najwcześniejsze cyfrowe samplowanie zostało wykonane w systemie EMS Musys, opracowanym przez Petera Grogono (oprogramowanie), Davida Cockerella (sprzęt i interfejs) oraz Petera Zinovieffa (projektowanie i obsługa systemu) w ich londyńskim (Putney) Studio c. 1969.

Pierwszym komercyjnie dostępnym syntezatorem samplującym był Computer Music Melodian Harry'ego Mendella (1976).

Wydany po raz pierwszy w latach 1977-78 Synclavier I wykorzystujący syntezę FM , ponownie licencjonowany przez firmę Yamaha i sprzedawany głównie na uniwersytetach, okazał się bardzo wpływowy zarówno wśród kompozytorów muzyki elektronicznej, jak i producentów muzycznych, w tym Mike'a Thorne'a , który wcześnie przyjął reklamę. świat, ze względu na swoją wszechstronność, najnowocześniejszą technologię i charakterystyczne dźwięki.

Pierwszym polifonicznym cyfrowym syntezatorem próbkowania był wyprodukowany w Australii Fairlight CMI , po raz pierwszy dostępny w 1979 roku. Te wczesne próbkowanie syntezatorów wykorzystywało syntezę opartą na próbkach falowych .

Narodziny MIDI

W 1980 roku grupa muzyków i kupców muzycznych spotkała się, aby ujednolicić interfejs, który nowe instrumenty mogłyby wykorzystywać do komunikowania instrukcji sterujących z innymi instrumentami i komputerami. Ten standard został nazwany Musical Instrument Digital Interface ( MIDI ) i był wynikiem współpracy między wiodącymi producentami, początkowo Sequential Circuits , Oberheim , Roland , a później innymi uczestnikami, w tym Yamaha , Korg i Kawai . Artykuł został napisany przez Dave'a Smitha z Sequential Circuits i zaproponowany Audio Engineering Society w 1981 r. Następnie, w sierpniu 1983 r., sfinalizowano specyfikację MIDI 1.0.

Technologia MIDI pozwala jednym naciśnięciem klawisza, ruchem pokrętła sterowania, ruchem pedału lub poleceniem z mikrokomputera, aby zdalnie i zsynchronizować każde urządzenie w studiu, przy czym każde urządzenie reaguje zgodnie z warunkami określonymi przez kompozytora.

Instrumenty MIDI i oprogramowanie sprawiły, że potężna kontrola zaawansowanych instrumentów jest łatwo dostępna dla wielu studiów i osób. Dźwięki akustyczne zostały ponownie zintegrowane w studiach poprzez samplowanie i instrumenty oparte na samplach ROM.

Miller Puckette opracował oprogramowanie do przetwarzania sygnałów graficznych dla 4X o nazwie Max (od Max Mathews ), a później przeniósł je na Macintosh (z Dave Zicarelli rozszerzył je dla Opcode ) w celu sterowania MIDI w czasie rzeczywistym, zapewniając dostępność kompozycji algorytmicznej większości kompozytorów ze skromnym oprogramowaniem komputerowym tło.

Sekwencery i automaty perkusyjne

Na początku lat 80-tych pojawiły się syntezatory basowe , z których najbardziej wpływowym był Roland TB-303 , syntezator basowy i sekwencer wydany pod koniec 1981 roku, który później stał się stałym elementem elektronicznej muzyki tanecznej , zwłaszcza acid house . Jednym z pierwszych, który go użył, był Charanjit Singh w 1982 roku, choć nie został spopularyzowany aż do „ Acid Tracks ” Phuture w 1987 roku. Sekwencery muzyczne zaczęły być używane około połowy XX wieku, a albumy Tomity w połowie lat 70. późniejsze przykłady. W 1978 roku Yellow Magic Orchestra wykorzystywała technologię komputerową w połączeniu z syntezatorem do produkcji muzyki popularnej, wcześnie wykorzystując mikroprocesorowy sekwencer Roland MC-8 Microcomposer .

Automaty perkusyjne , znane również jako maszyny rytmiczne, również zaczęły być używane pod koniec lat pięćdziesiątych, a późniejszy przykład to progresywny album rockowy Osamu Kitajimy Benzaiten (1974), w którym wykorzystano maszynę rytmiczną wraz z perkusją elektroniczną i syntezatorem. W 1977 roku Ultravox „ Hiroshima Mon Amour ” był jednym z pierwszych singli, w których wykorzystano perkusję przypominającą metronom automatu perkusyjnego Roland TR-77 . W 1980 roku firma Roland Corporation wypuściła TR-808 , jedną z pierwszych i najpopularniejszych programowalnych automatów perkusyjnych . Pierwszym zespołem, który go użył, była Yellow Magic Orchestra w 1980 roku, a później zyskała szeroką popularność dzięki wydaniu „ Sexual Healing ” Marvina Gaye'a i „ Planeta Rock ” Afriki Bambaataa w 1982 roku. TR-808 był podstawowe narzędzie późniejszej sceny techno w Detroit pod koniec lat 80. i był automatem perkusyjnym z wyboru Derricka Maya i Juana Atkinsa .

Chiptunes

Charakterystyczny dźwięk lo-fi muzyki chipowej był początkowo wynikiem ograniczeń technicznych wczesnych chipów dźwiękowych komputerów i kart dźwiękowych ; jednak od tego czasu dźwięk stał się poszukiwany sam w sobie.

Popularne, tanie, popularne układy dźwiękowe pierwszych komputerów domowych z lat 80. to SID serii Commodore 64 i General Instrument AY oraz klony (jak Yamaha YM2149) stosowane m.in. w ZX Spectrum , Amstrad CPC , kompatybilnych MSX i modelach Atari ST .

Późne lata 80. do lat 90.

Powstanie muzyki tanecznej

Synth-pop trwał do późnych lat 80., z formatem, który zbliżył się do muzyki tanecznej, w tym twórczością takich zespołów jak brytyjskie duety Pet Shop Boys , Erasure i The Communards , osiągając sukcesy przez większą część lat 90.

Trend ten trwa do dziś, a nowoczesne kluby nocne na całym świecie regularnie grają elektroniczną muzykę taneczną (EDM). Dziś elektroniczna muzyka taneczna ma stacje radiowe, strony internetowe i publikacje, takie jak Mixmag , poświęcone wyłącznie temu gatunkowi. Pomimo prób stworzenia przez branżę konkretnej marki EDM, inicjalizm pozostaje w użyciu jako termin zbiorczy dla wielu gatunków, w tym dance-pop , house , techno , electro i trance , a także ich podgatunków. Co więcej, gatunek ten znalazł komercyjne i kulturowe znaczenie w Stanach Zjednoczonych i Ameryce Północnej, dzięki szalenie popularnemu brzmieniu big room house /EDM, które zostało włączone do amerykańskiej muzyki pop i powstaniu komercyjnych rave'ów na dużą skalę , takich jak Electric Daisy Carnival , Tomorrowland i Ultra Music Festival .

Elektroniczna

Z drugiej strony, pod parasolem „electronica”, która była również sceną muzyczną na początku lat 90. w Wielkiej Brytanii , stała się szeroka grupa stylów muzycznych opartych na elektronice, przeznaczonych do słuchania, a nie stricte tanecznych . Zgodnie z artykułem opublikowanym w Billboard z 1997 r., „unia społeczności klubowej i niezależnych wytwórni ” zapewniła eksperymentalne i wyznaczające trendy środowisko, w którym akty elektroniczne rozwinęły się i ostatecznie dotarły do głównego nurtu, powołując się na amerykańskie wytwórnie, takie jak Astralwerks ( The Chemical Brothers , Fatboy Slim ). , The Future Sound of London , Fluke , Moonshine ( DJ Keoki ), Sims , City of Angels ( The Crystal Method ) za popularyzację najnowszej wersji muzyki elektronicznej.

2000 i 2010

Ponieważ technologia komputerowa stała się bardziej dostępna, a oprogramowanie muzyczne rozwinęło się, interakcja z technologią produkcji muzyki jest teraz możliwa przy użyciu środków, które nie mają związku z tradycyjnymi praktykami muzycznymi : na przykład wydajność laptopa ( laptronica ), kodowanie na żywo i algorytm Algorave . Ogólnie rzecz biorąc, termin Live PA odnosi się do każdego wykonania na żywo muzyki elektronicznej, czy to za pomocą laptopów, syntezatorów czy innych urządzeń.

Począwszy od około 2000 roku, pojawiły się pewne oparte na oprogramowaniu środowiska wirtualnego studia, a produkty, takie jak Propellerhead's Reason i Ableton Live , zyskały popularność. Takie narzędzia stanowią realną i opłacalną alternatywę dla typowych sprzętowych studiów produkcyjnych, a dzięki postępowi w technologii mikroprocesorowej możliwe jest obecnie tworzenie wysokiej jakości muzyki przy użyciu niewiele więcej niż jednego laptopa. Takie postępy zdemokratyzowały tworzenie muzyki, prowadząc do ogromnego wzrostu ilości domowej muzyki elektronicznej dostępnej dla ogółu społeczeństwa za pośrednictwem Internetu. Oparte na oprogramowaniu instrumenty i jednostki efektów (tzw. „wtyczki”) można włączyć do studia komputerowego za pomocą platformy VST. Niektóre z tych instrumentów są mniej lub bardziej dokładnymi replikami istniejącego sprzętu (takich jak Roland D-50, ARP Odyssey, Yamaha DX7 czy Korg M1). W wielu przypadkach te instrumenty oparte na oprogramowaniu są dźwiękowo nie do odróżnienia od ich fizycznego odpowiednika.

Gięcie obwodu

Zginanie obwodów to modyfikacja zabawek zasilanych bateriami i syntezatorów w celu tworzenia nowych niezamierzonych efektów dźwiękowych. Jego pionierem był Reed Ghazala w latach 60. XX wieku, a w 1992 r. Reed ukuł nazwę „gięcie obwodowe”.

Odrodzenie syntezatorów modułowych

Podążając za kulturą gięcia obwodów, muzycy zaczęli również budować własne syntezatory modułowe, wywołując ponowne zainteresowanie projektami z początku lat 60. XX wieku. Eurorack stał się popularnym systemem.

Zobacz też

- Klawilina

- Worek elektroniczny

- Lista gatunków muzyki elektronicznej

- Nowe interfejsy muzycznej ekspresji

- Ondiolina

- Kultura rave

- Muzyka spektralna

- Muzyka śledząca

- Kalendarium gatunków muzyki elektronicznej

- Muzyka elektroniczna na żywo

Przypisy

Źródła

- Aitken, Stuart (10 maja 2011), „Charanjit Singh o tym, jak wymyślił Acid House… by Mistake” , The Guardian , Londyn, nr. 10 maja

- Anderson, Jason (2008), Slaves to the Rhythm: Kanye West jest najnowszym, aby oddać hołd klasycznemu automatowi perkusyjnemu , strona internetowa CBC News , pobrana 5 czerwca 2011

- Angus, Robert (1984), "Historia zapisu magnetycznego, część pierwsza", Audio Magazine (sierpień): 27-33

- Anonimowy (1972), Notatki liniowe do The Varese Album , Columbia Records, MG 31078

- Anonymous (1979), „Artyści i producenci dążą do Inroads Overseas” , Billboard , nr. 26 maja, s. J–14, J–31

- Anonymous (2006), "1935 AEG Magnetophon Tape Recorder" , Mix Online , zarchiwizowane z oryginału 8 lutego 2013 , pobrane 5 czerwca 2011

- Anonim (2009), 23. doroczna międzynarodowa nagroda Dance Music Awards Nominees & Winners , Winter Music Conference, zarchiwizowane z 18 lutego 2009

- Anonimowy (2010), „Synthpop” , AllMusic( archiwum z dnia 10 marca 2011 r.)

- Bayly, Richard (jesień 1982 - lato 1983), "Ussachevsky on Varèse: An Interview 24 kwietnia 1979 w Goucher College", Perspektywy Nowej Muzyki , 21 (1/2): 145-51, doi : 10.2307/832872 , JSTOR 832872

- Begault, Durand R (1994), dźwięk 3-D dla wirtualnej rzeczywistości i multimediów , Boston: Academic Press, 1994, ISBN 978-0-12-084735-8( Przedruk online zarchiwizowany 10 sierpnia 2012 r. w Wayback Machine , faks Memorandum Technicznego NASA Ames Research Center 2000.

- Blashill, Pat (2002), "Sześć maszyn, które zmieniły świat muzyki" , Wired , tom. 10, nie. 5, s.

- Busoni, Ferruccio (1962), Szkic nowej estetyki muzyki , przekład dr Th. Baker i pierwotnie opublikowany w 1911 przez G. Schirmera. Przedrukowany w Three Classics in the Aesthetic of Music: Monsieur Croche the Dilettante Hater , Claude Debussy; Szkic nowej estetyki muzyki Ferruccio Busoni; Eseje przed Sonatą , Charles E. Ives, Nowy Jork: Dover Publications , Inc., s. 73-102

- Bussy, Pascal (2004), Kraftwerk: Man, Machine and Music (3rd ed.), Londyn: SAF, ISBN 0-946719-70-5

- Chadabe, Joel (2004), "Muzyka elektroniczna i życie", zorganizowany dźwięk , 9 (1): 3-6, doi : 10.1017/s1355771804000020 , S2CID 62189224

- Chowning, John (1973), „Synteza złożonych widm audio za pomocą modulacji częstotliwości”, Journal of the Audio Engineering Society , 21 (7): 526-534

- Collins, Nick (2003), „Generative Music and Laptop Performance”, Przegląd Muzyki Współczesnej , 22 (4): 67-79, doi : 10.1080/0749446032000156919 , S2CID 6273594

- Doornbusch, Paul (2005), The Music of CSIRAC, Australia's First Computer Music , z towarzyszącym nagraniem CD, Australia: Common Ground Publishers, ISBN 1-86335-569-3

- Eimert, Herbert (1958), "Co to jest muzyka elektroniczna?", Die Reihe , 1 (wydanie angielskie): 1-10

- Eimert, Herbert (1972), "Jak zaczęła się muzyka elektroniczna", The Musical Times , 113 (1550 (kwiecień)): 347-349, doi : 10.2307/954658 , JSTOR 954658(Pierwsza publikacja w języku niemieckim w Melos 39 (styczeń-luty 1972): 42-44.)

- Emmerson, Simon (2007), Żywa muzyka elektroniczna , Aldershot (Hants.), Burlington (VT): Ashgate, ISBN 978-0-7546-5546-6, (tkanina) (pbk)

- Engel, Friedrich Karl (2006), Innowacje techniczne Waltera Webera w Reichs-Rundfunk-Gesellschaft (PDF) , Richardhess.com , pobrane 18 czerwca 2010

- Engel, Fryderyk Karl; Hammar, Peter (2006), A Selected History of Magnetic Recording (PDF) , dalsza edycja przez Richarda L. Hessa, Richardhess.com , pobrane 18 czerwca 2010

- Fildes, Jonathan (2008), "„Najstarsza” muzyka komputerowa ujawniona” , BBC News , nr 17 czerwca

- Frankenstein, Alfred (1964), "Kontinuum przestrzenno-dźwiękowe w całkowitej ciemności", San Francisco Chronicle , nr. 17 października(Fragment istnieje w Historii Muzyki Eksperymentalnej w Północnej Kalifornii )

- Fujii, Koichi (2004), „Chronologia wczesnej muzyki elektroakustycznej w Japonii: jakie rodzaje materiałów źródłowych są dostępne?”, zorganizowany dźwięk , 9 : 63-77, doi : 10.1017/S1355771804000093 , S2CID 62553919

- Gard, Stephen (2004), Nasty Noises: „Błąd” jako element kompozycyjny , Sydney Conservatorium of Music, Sydney eScholarship Repository

- Gayou, Evelyne. (2007a). „GRM: Zabytki na trasie historycznej”. Zorganizowany dźwięk 12, nie. 3:203-11.

- Glinsky, Albert (2000), Theremin: Ether Music and Espionage , Music in American Life, przedmowa Roberta Mooga., Urbana i Chicago: University of Illinois Press, ISBN 0-252-02582-2

- Gluck, Robert J (2005), „Pięćdziesiąt lat muzyki elektronicznej w Izraelu” , zorganizowany dźwięk , 10 (2): 163-80, doi : 10.1017/S1355771805000798 , S2CID 54996026

- Harris, Craig (2018), Tom Dissevelt: Biografia , Allmusic.com

- Hertelendy, Paul (2008), „ Spatial Sound's Longest Running One-Man Show ”, artssf.com, zarchiwizowane z oryginału w dniu 7 lipca 2011 r. , pobrane 3 marca 2011 r.

- Holmes, Thomas B (2002), Muzyka elektroniczna i eksperymentalna: Pionierzy w dziedzinie technologii i kompozycji (2nd ed.), Londyn: Routledge Music / Songbooks, ISBN 0-415-93643-8, (tkanina) (pbk)

- Holmes, Thom (2008), Muzyka elektroniczna i eksperymentalna: technologia, muzyka i kultura (3rd ed.), Londyn i Nowy Jork: Routledge, ISBN 978-0-415-95781-6, (tkanina); (pbk); (e-book)

- Holmes, Thom (2012). Muzyka elektroniczna i eksperymentalna: technologia, muzyka i kultura (wyd. 4). Nowy Jork: Routledge. ISBN 978-0-415-89646-7.(płótno); ISBN 978-0-415-89636-8 (pbk); ISBN 978-0-203-12842-8 (ebook).

- Johnson, Steven (2002), New York Schools of Music and Visual Arts: John Cage, Morton Feldman , New York: Routledge , ISBN 0-415-93694-2

- Krause, Manfred (2002), „Konwencja AES 112 (kwiecień)”, Legendarny „Magnetofon” AEG , Audio Engineering Society E-Library., dokument nr 5605. Streszczenie .

- Kurtz, Michael (1992). Stockhausen: Biografia . Przetłumaczone przez Richarda Toopa . Londyn: Faber i Faber. ISBN 0-571-14323-7.

- Jenkins, Mark (2007), Analog Synthesizers: Understanding, Performing, Buying: From the Legacy of Moog to Software Synthesis , Amsterdam: Elsevier , ISBN 978-0-240-52072-8

- Lange, A[rt]. (2009). „Muzyka konkretna i dawna muzyka elektroniczna”. W The Wire Primers: A Guide To Modern Music , pod redakcją Roba Younga, 173-180. Londyn: Verso.

- Lebrecht, Norman (1996), The Companion to 20th-Century Music , Da Capo Press., ISBN 0-306-80734-3, (pbk)

- Loubet, Emmanuelle (1997), przetłumaczone przez Brigitte Robindoré i Curtis Roads, „Początki muzyki elektronicznej w Japonii, z naciskiem na NHK Studio: 1950 i 1960”, Computer Music Journal , 21 (4): 11-22 , doi : 10.2307/3681132 , JSTOR 3681132

- Loy, Gareth (lato 1985), „About Audium — A Conversation with Stanley Shaff” , Computer Music Journal , 9 (2): 41-48, doi : 10.2307/3679656 , JSTOR 3679656 , zarchiwizowane z dnia 24 czerwca 2017 r. , pobrano 3 marca 2011

- Luening, Otto (1968), "Niedokończona historia muzyki elektronicznej", Music Educators Journal , 55 (3 (listopad)): 42-49, 135-142, 145, doi : 10.2307/3392376 , JSTOR 3392376 , S2CID 143454942

- Maginnis, Tom (2011), The Man Who Dies Every Day: Ultravox: Song Review , Allmusic.com, zarchiwizowane z oryginału 11 marca 2011(na stronie webcitation.org)

- Mattis, Olivia (2001), „Mathews, Max V (ernon)”, The New Grove Dictionary of Music and Musicians , pod redakcją Stanleya Sadie i Johna Tyrella, Londyn: Macmillan

- Montanaro, Larisa Katherine (2004), „A Singer's Guide to Performing Works for Voice and Electronics” (PDF) , praca dyplomowa , Austin: The University of Texas at Austin, zarchiwizowana z oryginału (PDF) 11 września 2008 r. , pobrane 28 czerwiec 2008

- Morawska-Büngeler, Marietta (1988), Schwingende Elektronen: Eine Dokumentation über das Studio für Elektronische Musik des Westdeutschen Rundfunk in Köln 1951–1986 , Kolonia-Rodenkirchen: PJ Tonger Musikverlag

- Norman, Katharine (2004), Sounding Art: Eight Literary Excursions through Electronic Music , Aldershot: Ashgate Publishing, Ltd, ISBN 0-7546-0426-8

- Ozab, David (2000), Beyond the Barline: One Down, Two to Go , strona internetowa ATPM (About This Specific Macintosh) , pobrana 13 stycznia 2010

- Palombini, Carlos (1993). „Machine Songs V: Pierre Schaeffer: Od badań nad hałasami do muzyki eksperymentalnej”. Dziennik muzyki komputerowej 17, nr. 3 (jesień): 14-19. doi : 10.2307/3680939 . JSTOR 3680939 .

- Rhea, Tom (1980), "Syntezator RCA i jego syntezatory" , Współczesna klawiatura , Publikacje GPI, tom. 6, nie. 10 (październik), s. 64 n. , pobrane 5 czerwca 2011 r.

- Roads, Curtis (1996), The Computer Music Tutorial , Cambridge, MA: MIT Press, ISBN 0-262-18158-4, (tkanina) (pbk)

- Roads, Curtis (2015), Komponowanie muzyki elektronicznej: nowa estetyka , Oxford University Press, ISBN 978-0-19-537324-0

- Russ, Martin (2009), Sound Synthesis and Sampling (wyd. trzecie), Amsterdam i Boston: Elsevier; Oxford i Burlington: Focal, ISBN 978-0-240-52105-3

- Russcol, Herbert (1972), Wyzwolenie dźwięku: wprowadzenie do muzyki elektronicznej , Englewood Cliffs, New Jersey: Prentice-Hall

- Schutterhoef, Arie van (2007), Sogitec 4X , Knorretje, een Nederlandse Wiki over muziek, geluid, soften hardware., zarchiwizowane z oryginału 4 listopada 2013 , pobrane 13 stycznia 2010

- Schwartz, Elliott (1975), Muzyka elektroniczna , Nowy Jork: Praeger

- Smirnov, Andrey (2014), Russian Electroacoustic Music from the 1930s-2000s (PDF) , zarchiwizowane z oryginału (PDF) w dniu 3 stycznia 2017 r. , pobrane 30 czerwca 2016 r.

- Snell, Karen Crocker (2006), „Człowiek za dźwiękiem” , Santa Clara Magazine , Santa Clara University, no. Lato , pobrane 13 stycznia 2010

- Snyder, Jeff (1998), Pierre Schaeffer: Wynalazca Musique Concrete , zarchiwizowane od oryginału w dniu 15 maja 2008

- Sofer, Danny; Lynner, Doug (1977), „Wywiad Pata Gleesona”, Synapse: The Electronic Music Magazine , 1 (5 (styczeń-luty)): 21-24, 35

- Stockhausen, Karlheinz (1971). Dieter Schnebel (red.). Texte zur Musik . DuMont Dokumente. Tom. 3. Kolonia: DuMont Buchverlag. ISBN 3-7701-0493-5.

- Stockhausen, Karlheinz (1978). Christoph von Blumroder (red.). Texte zur Musik 1970–1977 . DuMont Dokumente. Tom. 4. Kolonia: DuMont Buchverlag. ISBN 3-7701-178-1.

- Tal, Josef; Markel, Shlomo (2002), Musica Nova w trzecim tysiącleciu , Tel-Aviv: Israel Music Institute, ISBN 965-90565-0-8. Wydane również w języku niemieckim, jako Musica Nova im dritten Millenium , Tel-Aviv: Israel Music Institute., 2002, ISBN 965-90565-0-8

- Toop, David (2016), Into the Maelstrom: Music, Improwization and the Dream of Freedom , Bloomsbury Academic, ISBN 978-1-5013-1451-3

- Ungeheuer, Elena (1992), Wie die elektronische Musik "erfunden" wurde...: Quellenstudie zu Werner Meyer-Epplers musikalischem Entwurf zwischen 1949 i 1953 , Kölner Schriften zur neuen Musik 2., Mainz i Nowy Jork: Schott, ISBN 3-7957-1891-0

- Unterberger, R (2002), „Rock progresywny”, All Music Guide to Rock: the Definitive Guide to Rock, Pop, and Soul , w V. Bogdanov, C. Woodstra i ST Erlewine, red. (3rd ed.), Milwaukee, Wisconsin: Backbeat Books, ISBN 0-87930-653-X

- Vercoe, Barry (2000), „Naprzód” , The Csound Book: Perspectives in Software Synthesis, Sound Design, Signal Processing and Programming , pod redakcją Richarda Boulangera , Cambridge, Massachusetts: MIT Press, s. xxvii-xxx, ISBN 0-262-52261-6, zarchiwizowane z oryginału w dniu 30 stycznia 2010 r. , pobrane 30 czerwca 2008 r

- Vine, Richard (15 czerwca 2011), „Tadao Kikumoto wymyśla Rolanda TB-303” , The Guardian , Londyn, nr. 14 czerwca , pobrane 23 grudnia 2011

- Weidenaar, Reynold (1995), Magic Music from the Telharmonium: The Story of the First Music Synthesizer , Metuchen, New Jersey: Scarecrow Press, Inc., ISBN 0-8108-2692-5

- Xenakis, Iannis (1992), sformalizowana muzyka : myśl i matematyka w kompozycji , Harmonologia Series, nr 6 (poprawione, rozszerzone ed.), Stuyvesant, New York: Pendragon Press, ISBN 978-1-57647-079-4

- Yabsley, Alex (2007), Back to the 8 Bit: A Study of Electronic Music Counter-Culture , Gamemusic4all.com , pobrane 5 czerwca 2011